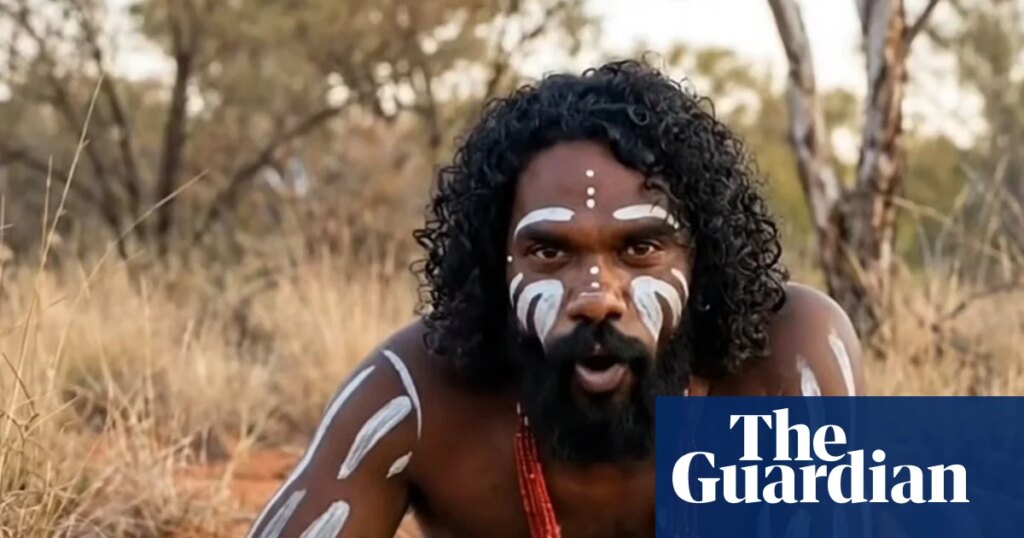

Com cachos escuros e olhos castanhos, Jarren está no meio do interior australiano, com terra vermelha a seus pés e uma cobra se desenrolando na sua frente.

Numa série de vídeos online, a estrela das redes sociais, conhecida online como Bush Legend, caminha por florestas densas ou conduz por estradas desertas em busca de águias de cauda em cunha. Muitos dos vídeos são configurados com instrumentos de percussão pulsantes e yidakis (didgeridoo).

Sua voz soa como um cruzamento entre Costa Georgiadis da Gardening Australia e Steve Irwin. Seu discurso é salpicado de “companheiro” e “caramba”, enquanto ele compartilha apaixonadamente trechos com milhares de seus seguidores sobre a vida selvagem australiana, desde cobras venenosas e crocodilos até aranhas vermelhas e os indescritíveis papagaios noturnos, antes considerados extintos.

Seus seguidores deixam comentários de admiração, maravilhados com a forma como ela consegue se aproximar tanto dos animais e até sugerindo que ela precisa de seu próprio programa de TV.

Mas nada disso é real. A vida selvagem e o homem que a apresenta são criações da IA.

Criada em outubro de 2025, Meta indica que a conta é baseada na Nova Zelândia, e a conta do Instagram originalmente compartilhou uma conta de notícias satíricas gerada por IA chamada ‘Nek Minute News antes de passar para o conteúdo sobre vida selvagem. As encarnações anteriores de Bush Legend mostram o personagem com pintura corporal branca que parece imitar o ocre e um colar de contas adornando seu pescoço.

Nesta semana, a conta Bush Legend tinha 90.000 seguidores no Instagram e 96.000 no Facebook. Ele diz que seu objetivo é aumentar a conscientização e a educação sobre a vida selvagem australiana.

A Guardian Australia entrou em contato com a pessoa que se acredita ter criado a conta, que é uma sul-africana que mora na Nova Zelândia. Eles não responderam a múltiplas abordagens.

'Achatamento cultural'

A escolha de criar um avatar de um indígena levantou preocupações éticas.

A Dra. Terri Janke, advogada e especialista em propriedade intelectual e cultural indígena, diz que as imagens e o conteúdo são “notáveis” pelo seu realismo.

“Você acha que é real, eu estava apenas navegando e pensei: 'Como é que nunca ouvi falar desse cara?' “É mortal, deveria ter seu próprio show”, diz ele. “Ele é o Steve Irwin negro? Com suas calças verdes ou cáqui, ele se parece um pouco com Steve Irwin e David Attenborough.

Mas embora as mulheres Wuthathi, Yadhaigana e Meriam digam que os vídeos envolventes são “bastante incríveis quando vistos como uma ferramenta para a educação”, a criação de um avatar aparentemente indígena é ofensiva e acarreta um risco de “achatamento cultural”.

“De quem foi a imagem pessoal que eles usaram para criar essa pessoa? Eles reuniram pessoas?” ela pergunta. “Eu me sinto um pouco enganado por tudo isso.”

O conteúdo gerado pela IA representa um risco particular para as comunidades marginalizadas e pode ser considerado roubo de propriedade cultural e intelectual. Também potencialmente elimina oportunidades de relatos autênticos, como vídeos criados pela vasta rede de guardas florestais aborígines.

“É um roubo muito insidioso porque também envolve danos culturais”, diz Janke. “Por causa da discriminação… os impactos dos estereótipos e do pensamento negativo, esses impactos são mais severos.”

Janke diz que é possível usar eticamente a tecnologia de IA para criar conteúdo sobre os povos das Primeiras Nações, mas isso requer o consentimento e a participação dos povos das Primeiras Nações.

Tamika Worrell, professora sênior de estudos críticos indígenas na Universidade Macquarie, diz que o avatar de IA é uma forma de apropriação cultural e “blackface digital” em que uma pessoa não negra cria uma caricatura negra ou indígena online.

Os Kamilaroi mulheres afirma que a proliferação de ferramentas de IA sem barreiras legislativas adequadas significa que imagens, conhecimentos culturais e histórias podem ser transmitidos sem o consentimento apropriado.

“A IA se torna esta nova plataforma sobre a qual não temos controle ou voz”, diz ele.

“Não apenas histórias ou linguagem, mas também imagens reais nossas podem muitas vezes ser tiradas de pessoas que faleceram, ou simplesmente combinar uma variedade de pessoas diferentes (para criar um avatar de IA) sem qualquer responsabilidade perante as comunidades de onde essas pessoas vêm.

“É o lado negro da IA: as pessoas podem apenas gerar obras de arte, gerar pessoas, (mas) na verdade não interagem com os povos indígenas.”

O potencial de dano é duplo: tais narrativas padrão partilham os aspectos “palatáveis” ou “confortáveis” do conhecimento e experiência cultural indígena, em vez da realidade mais complexa; e também tem o potencial de amplificar o racismo.

“Eu estava olhando os comentários em uma postagem mais recente do Bush Legend. Vemos os mesmos comentários racistas que sabemos que a máfia faz online. Vemos que eles também se aplicam novamente a uma pessoa com inteligência artificial”, diz ele.

Toby Walsh, pesquisador premiado e professor científico de inteligência artificial na Universidade de Nova Gales do Sul, diz que a IA é treinada para reproduzir informações e representá-las em conjuntos de dados de grande escala com preconceitos integrados, o que significa que não é imune a conteúdo racista ou prejudicial.

“Eles carregarão os preconceitos desses dados de treinamento”, diz ele. “Certos grupos podem ser estereotipados porque os dados de vídeo ou imagem que existem nesse grupo on-line são um tanto estereotipados. Portanto, vamos perpetuar esse estereótipo no futuro.”

O Guardian Australia tentou entrar em contato com o criador da página por meio de várias contas de mídia social e e-mail, mas ainda não recebeu resposta.

A conta Bush Legend aparentemente abordou as críticas através do seu avatar, dizendo que a página não procura “representar qualquer cultura ou grupo”. “Este canal é simplesmente sobre histórias de animais”, disse a criação da IA em um vídeo na semana passada.

Ele prosseguiu dizendo que a página “não pede dinheiro, doações ou apoio” e que o conteúdo é “gratuito para visualização”, sugerindo que as pessoas “rolem” se não gostarem. Os plug-ins anteriores pediam que seus seguidores se inscrevessem por US$ 2,99 por mês.

Meta foi contatada para mais comentários.

Walsh diz que embora a literacia digital possa ajudar os utilizadores a identificar conteúdos de IA, os “indicadores” que ajudam a identificá-los são cada vez mais difíceis de detectar. “Se não for agora, num futuro muito próximo, será quase impossível identificar por si mesmo se isso era real ou falso”, diz Walsh.

“Costumávamos acreditar nas coisas que víamos, porque antes as coisas que víamos eram em grande parte reais.

“Agora não é difícil falsificar coisas. É incrivelmente fácil falsificar coisas de uma forma muito convincente, por isso vamos ultrapassar os limites entre o que é verdadeiro e o que é falso.”